Ewa Trębacz

LAMENT NAD ZAGŁADĄ MIASTA UR

Asamblaże z nieistniejącego miasta

SPRAWOZDANIE Z REALIZACJI (nagrania materiału dźwiękowego)

|

Lament wyśpiewany w języku, którego brzmienia nikt już nie pamięta.

Projekt, oparty na kreatywnej interpretacji starożytnego tekstu sumeryjskiego Lament nad zagładą miasta Ur, obejmował realizację nagrań dźwiękowych przez kompozytorkę Ewę Trębacz we współpracy z Anną Niedźwiedź (głos, antropolog kulturowy), a następnie stworzenia na ich bazie hybrydowych form dźwiękowych i audiowizualnych - asamblaży. Formy te mogą być prezentowane w formie ustalonej, ale również performatywnej, z założenia mając charakter modularny i przeznaczony do dalszej twórczej interpretacji (np. poprzez skomponowanie partii wokalno-instrumentalnych do wykonania na koncercie czy poprzez rozwinięcie ich z użyciem innych mediów, np. wizualizacji). Projekt z założenia ma formę otwartą i będzie kontynuowany w przyszłości, kolejne asamblaże będą wyrastać na gruncie tych już stworzonych, reinterpretując tekst w nowych kontekstach, interakcjach i przestrzeniach. |

|

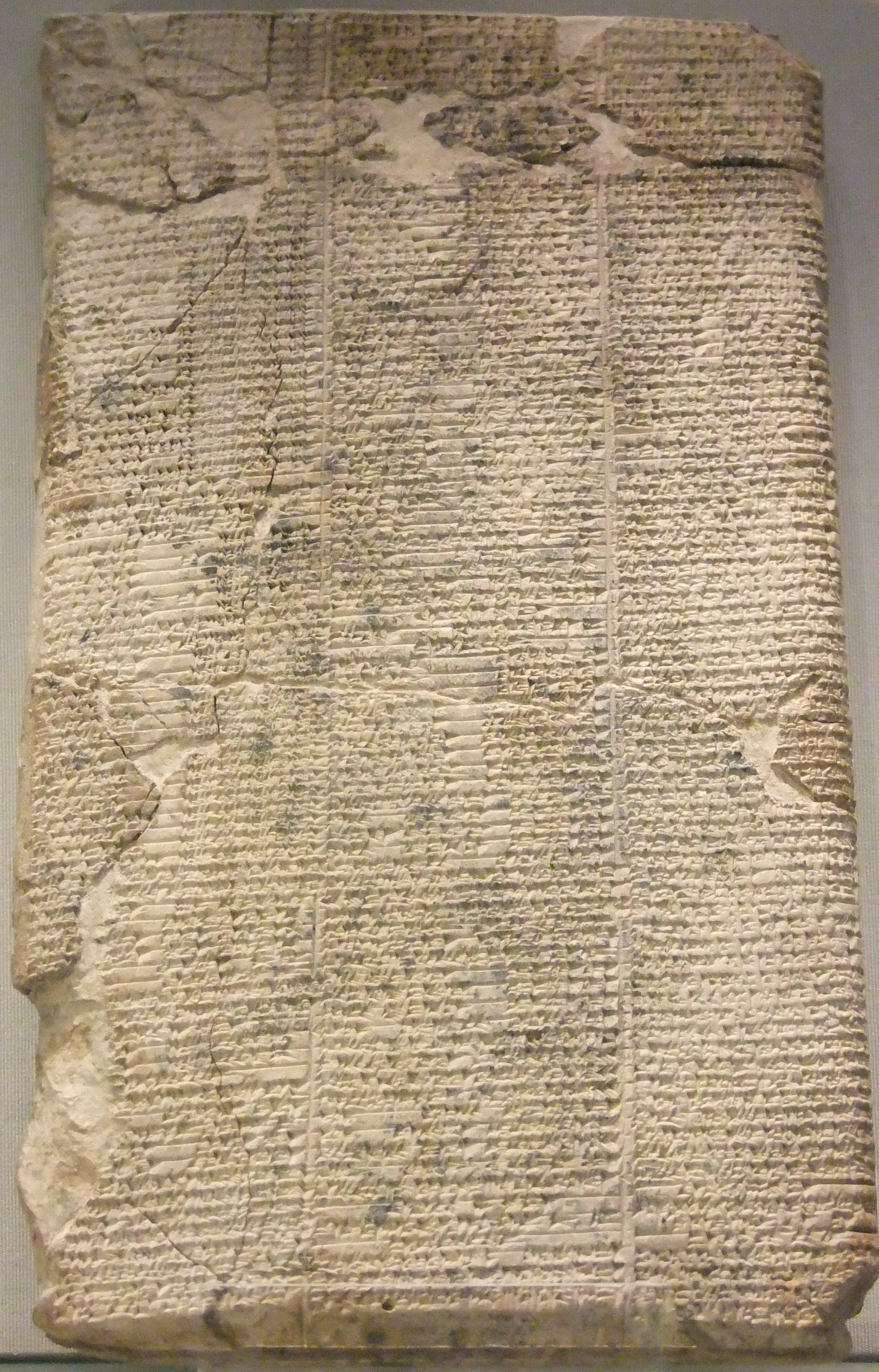

Lament jest specyficzną formą poetycką wyrażającą uczucia żalu i żałoby. Pięć starożytnych sumeryjskich lamentów miejskich jest związanych ze zniszczeniem tych miast przez wojnę. Wybrane fragmenty jednego z nich - Lamentacja nad zagładą miasta Ur (ok. 2000 p.n.e.) - stały się bezpośrednią bazą do interpretacji. Lamentacja ta jest wykonywana przez głos żeński - opiekuńczą boginię Ningal płaczącą nad swoim miastem, którego nie była w stanie ochronić przed niszczycielską „burzą”.

Oprócz warstwy tekstowej, projekt skupił się na sensorycznym i przestrzennym wymiarze dźwięku oraz jego mocy współtworzenia rytuałów żałobnych. Jest to swego rodzaju kontemplacja przemijania dźwięków i ich roli w obrzędach przejścia związanych ze śmiercią, przemijaniem, odchodzeniem, stratą i żałobą.

Asamblaże: płynne, przypadkowe, niepowtarzalne momenty w czasie

Celem projektu było (i będzie w kolejnych iteracjach) - stworzenie swojego rodzaju asamblaży - wychodząc od tekstu oryginalnego, poprzez poszukiwanie znaczeń słów, które wydają się uniwersalne, aż po przywołanie odległej przeszłości, do której nie mamy bezpośredniego dostępu.

Pojęcie asamblażu wiąże się z interpretacją rzeczywistości poprzez kategorię tworzonych chwilowo i unikalnych układów, które z kolei same tworzą i generują coś nowego, ale w zasadzie są ulotne, płynne, trochę przypadkowe i niepowtarzalne. Asamblaże dotyczą również wyjścia poza antropocentryczne postrzeganie rzeczywistości i podkreślenia relacyjności ludzi, zwierząt, ciał, przestrzeni, roślin, przedmiotów, różnorodnej materii i jej różnych faktur, maszyn i technologii itp.

ROLE

ROLE

Ewa Trębacz

- kompozytorka, artystka intermedialna

Anna Niedźwiedź

- głos, improwizacja,

ekspertyza w dziedzinie antropologii kulturowej

Anna Niedźwiedź - profesor Uniwersytetu Jagiellońskiego - jest antropolożką kulturową, zajmującą się m.in. antropologią ciała i przestrzeni oraz badaniami religii i rytuałów, w tym rytuałów żałobnych jako wydarzeń performatywnych. Ewa Trębacz and Anna Niedźwiedź współpracują ze sobą od ponad 20 lat.

ETAPY REALIZACJI PROJEKTU

ETAP 1: realizacja nagrań / tworzenie materiału źródłowego

Początkowy etap naszego projektu obejmował realizację nagrań dźwiękowych przez Ewę Trębacz oraz Annę Niedźwiedź (głos, improwizacja, ekspertyza w dziedzinie antropologii kulturowej i rytuałów żałobnych), w iteracyjnym, wielowarstwowym procesie twórczej eksploracji tekstu literackiego w jego oryginalnym języku. Interpretacja ta była oparta zarówno na antropologicznej wiedzy o rytuałach żałoby jak i subiektywnej, emocjonalnej reakcji na tekst sumeryjski.

Rytuały przejścia związane ze śmiercią, umieraniem i stratą przybierają różne formy w różnych kulturach. Składają się na nie na przykład śpiew, recytacja, krzyk, głośny płacz, ale także hałas, nawet śmiech, rytmiczne wzory i intensyfikacja dźwięków, a z drugiej strony ich przejście do rytualnie utrzymywanej ciszy.

W antropologicznych podejściach do rytuału podkreśla się jego transformacyjną i terapeutyczną moc. Szczególnie ważne jest fizyczne zaangażowanie uczestników, ponieważ to w i poprzez ich ciała rytuał jest tworzony i się dzieje. Ważna rola dźwięków wynika z ich fizyczności i materialności, która dosłownie przenika przestrzeń i dotyka ciał uczestników rytuału. Jednocześnie dźwięk zawsze przywołuje przemijalność i niepowtarzalną jedność, wynikającą z ciągle zmieniającego się układu - tymczasowego zestawienia określonych przestrzeni, obiektów, ciał.

Materiał dźwiękowy powstawał na przestrzeni kilku lat (podczas szeregu improwizacyjnych sesji nagraniowych, interpretujących w różny sposób wybrane fragmenty tekstu. W praktyce polegało to na wielokrotnej interpretacji tego samego fragmentu tekstu w różnych kontekstach, i tworzeniu odmienne, często kontrastujących ze sobą wersji. Nagrania były realizowane w Polsce (Kraków) oraz Stanach Zjednoczonych (stan Washington).

Nagrania były realizowane na dwa sposoby:

a) Nagrania ambisoniczne w przestrzeniach akustycznych - traktując te przestrzenie jako katalizator improwizacji (bezpośrednia interakcja z konkretną przestrzenią).

- Nagrania były zrealizowane przez Ewę Trębacz za pomocą mikrofonów ambisonicznych 1 rzędu - CoreSound TetraMic, Soundfield ST-250 oraz Zoom VR, a następnie konwertowane do ambisonii 3 rzędu, w którym to formacie odbywało się ich dalsze przetwarzanie. W niektórych fragmentach - głos Anny Niedźwiedź był dodatkowo wspomagany przez pojedyncze dźwięk waltorni (w wykonaniu Josiah Boothby) oraz skrzypiec (Ewa Trębacz).

Przykłady dźwiękowe:

b) Proces pośredni - poprzez nagrywanie mniejszych fragmentów (mikro-fraz i indywidualnych motywów) przez Annę Niedźwiedź w formacie 2 kanałowym. Te nagrania były następnie przetwarzane przez Ewę Trębacz - konwertowane do ambisonii 3 rzędu, umieszczane w wirtualnych przestrzeniach akustycznych (za pomocą tzw. impulse response) i następnie dalej manipulowane za pomocą transformacji ambisonicznych. Proces ten często odbywał się iteracyjnie, poprzez kreowanie kolejnych wersji na bazie instrukcji, wynikających z rezultatów w wersji poprzedniej.

Przykłady dźwiękowe:

W procesie nagrywania dźwięku każda chwila jest wyjątkowa, a wynik zależy od złożonej sieci czynników. Należą do nich interakcja między artystą a otaczającą przestrzenią, której warunki akustyczne są determinowane przez specyficzne cechy fizyczne w danym momencie. Podczas nagrań wspólnie szukałyśmy momentów, w których na poziomie emocjonalnym mogłybyśmy nawiązać kontakt z przestrzenią doświadczaną tu i teraz, przywołaną do chwili obecnej słowami wypowiedzianymi przez nieznajomego człowieka 4000 lat temu. Była to próba dotarcia do ludzkich emocji - rodzaj archeologii tekstu literackiego, poprzez ucieleśnienie i ożywienie go głosem i fizyczną interakcją z przestrzenią.

c) Transformacje ambisoniczne nagrań głosu

Do manipulacji przestrzennych materiału źródłowego Ewa Trębacz posługiwała się językiem programowania SuperCollider wraz z pakietem ATK - the Ambisonic Toolkit, a także oprogramowaniem IEM i Aalto SPARTA (pluginy do oprogramowania DAW - REAPER).

Pierwszy etap transformacji obejmował przestrzenną dekompozycję nagranych dźwięków (za pomocą pakietu ATK), a następnie dalszą manipulację i re-kompozycję tego materiału. Celem tego procesu było tworzenie unikalnych obiektów dźwiękowych 3D wielu wariantach.

Przykłady dźwiękowe:

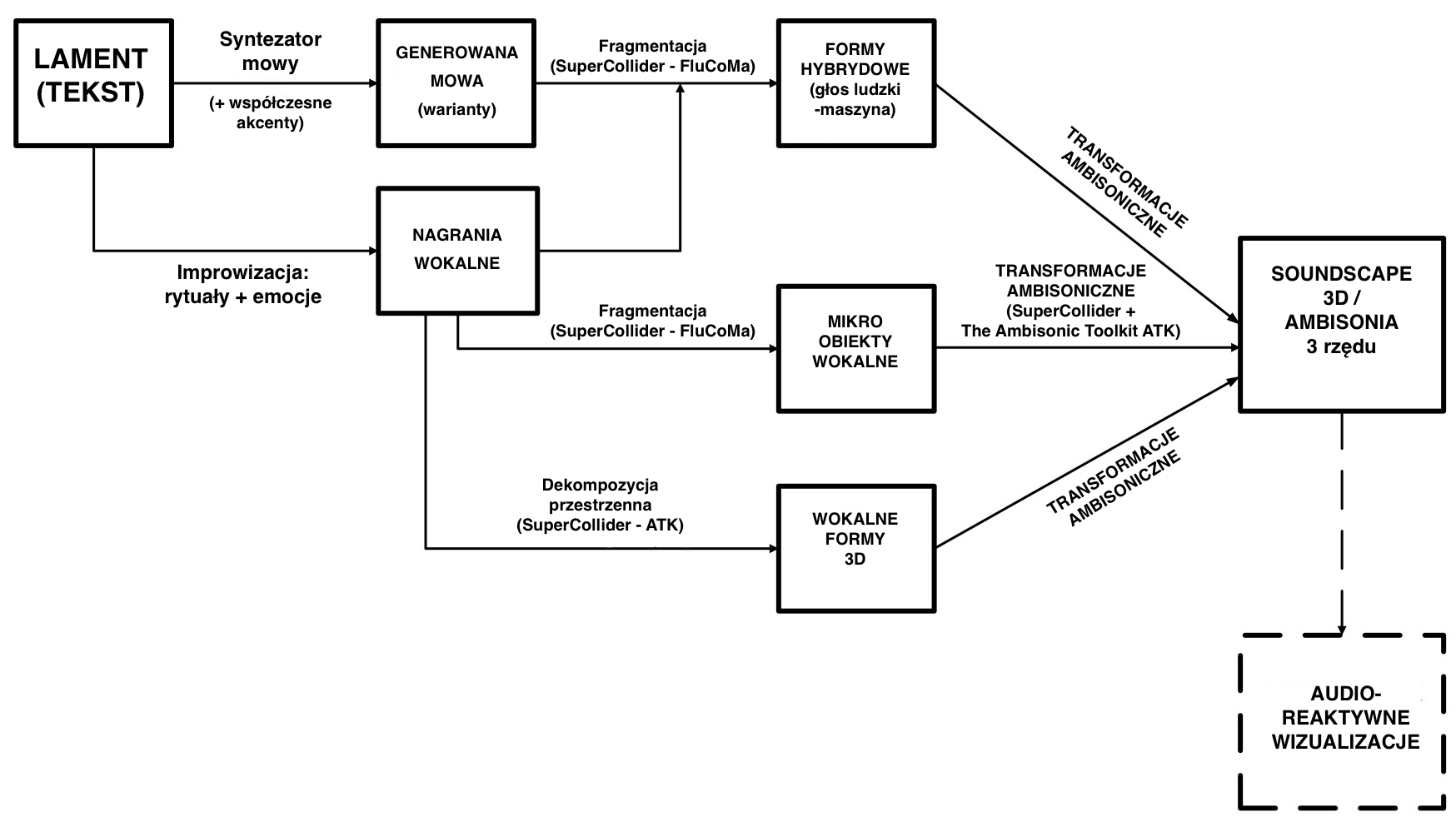

2) ETAP 2 - generacja tekstu, hybrydyzacja źródłowego materiału za pomocą uczenia maszynowego oraz transformacji przestrzennych. Rezultat: hybrydowe krótkie formy dźwiękowe, formy przejściowe pomiędzy głosem ludzkim a maszynowym.

a) Generacja mowy w j. sumeryjskim z zastosowaniem algorytmów sztucznej inteligencji

W tym etapie kompozytorka zastosowała syntezator mowy (na bazie sztucznej inteligencji), generując fragmenty tekstu w różnych wariantach - na bazie wymowy współczesnych języków.

Celem było stworzenie różnych interpretacji, z różniącą się wymową i akcentami. Ponieważ oryginalna wymowa j.sumeryjskiego pozostanie dla nas - w 21 wieku - zagadką, kompozytorka postanowiła wykorzystać algorytmy uczenia maszynowego do wygenerowania różnych wersji tekstu. Rezultat nie miał w żaden sposób na celu odtworzenia oryginalnej wymowy (to jest niemożliwe) ale stworzenia zróżnicowanej bazy dźwiękowych wariantów na podstawie dzisiejszych języków.,

b) Tworzenie form hybrydowych poprzez fragmentację i re-kompozycję głosu ludzkiego oraz generowanej mowy - za pomocą algorytmów uczenia maszynowego.

W kolejnym kroku, uczenie maszynowe zostało wykorzystywane do fragmentacji i re-aranżacji zarówno nagrań źródłowych (głos Anny Niedźwiedź) i komputerowo generowanych wariantów mowy. Za pomocą pakietu Fluid Corpus Manipulation (flucoma.org) i języka programowania oraz syntezy dźwięku SuperCollider, kompozytorka dokonała fragmentacji tego materiału dźwiękowego i następnie zorganizowała ten rozdrobniony materiał w wizualne mapy spektralne, grupując dźwięki o podobnej charakterystyce spektralnej. Następnie mapy te były aktywowane (na żywo) w celu generacji hybrydowych form, łączących ludzki głos z maszynowymi wariantami.

Rezultatem stały się hybrydowe formy przejściowe pomiędzy głosem człowieka i maszyny, płynnie przechodzące od śpiewanych lamentacji do mówionego słowa, i tworząc chór hybrydowych głosów. Formy te zostały następnie poddane manipulacji przestrzennej w ambisonii 3 rzędu.

Przykłady dźwiękowe:

Powyższy materiał dźwiękowy, wyprowadzony bezpośrednio z tekstu Lamentu, został skomponowany w trójwymiarowy obraz dźwiękowy, zrealizowany w ambisonii 3 rzędu:

LAMENTACJE - ASAMBLAŻE 1 i 3

[Text Source: ETCSL, University of Oxford ]

ETAP 3: TRANSKODOWANIE

- tworzenie mostów między różnymi mediami oraz wyjście poza strefę dźwięku

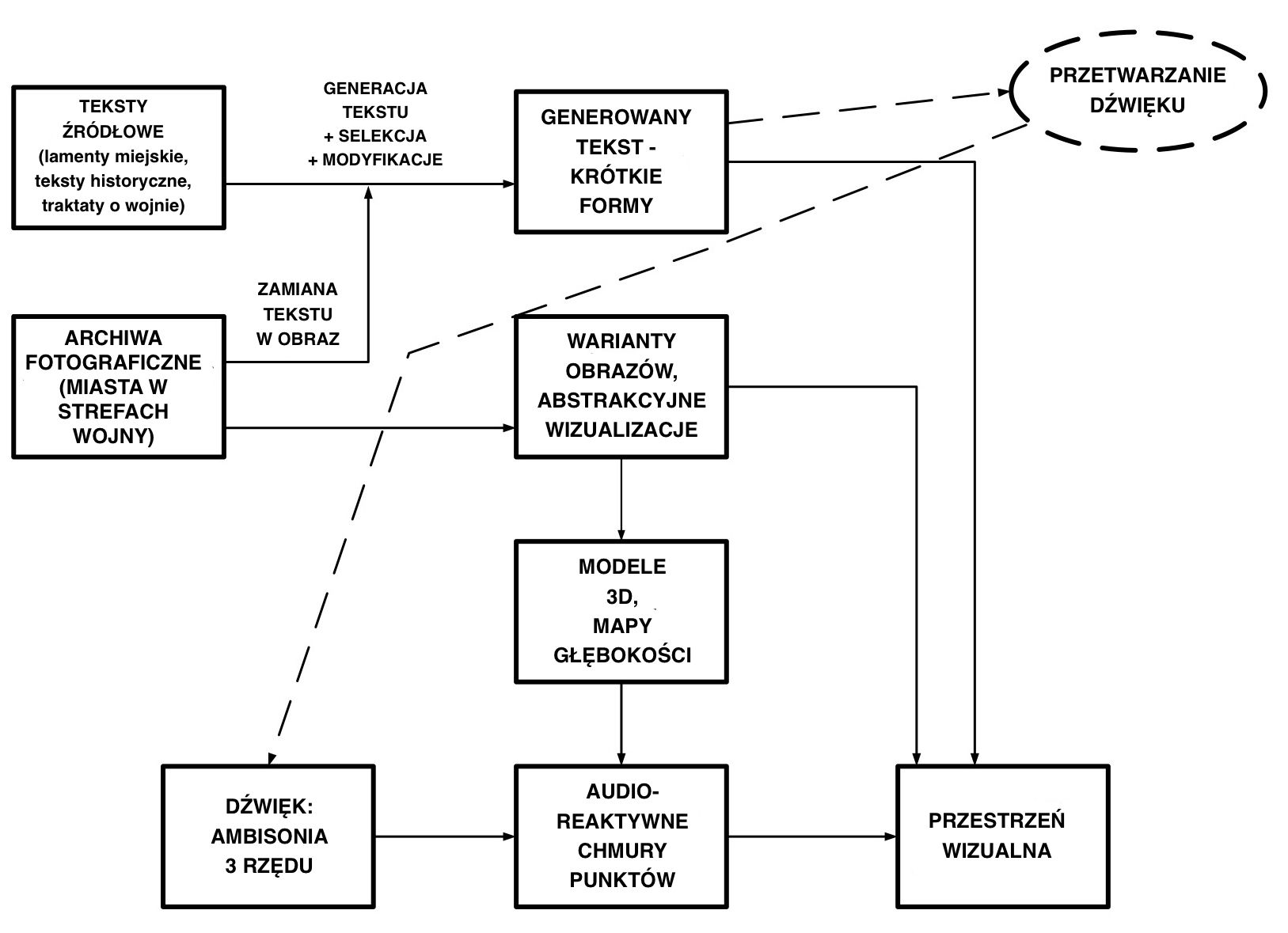

W etapie tym kompozytorka wychodzi poza medium dźwięku, włączając do repertuaru bezpośrednie przetwarzanie tekstu oraz obrazu, i tworząc formy przejściowe pomiędzy nimi, m.in. wykorzystując metody uczenia maszynowego.

1) Przetwarzanie maszynowe języka naturalnego - objęło generację tekstu na podstawie angielskiego tłumaczenia tekstu pięciu tzw. lamentacjacji miejskich, ale również historycznych tesktów na temat wojny oraz współczesnych dokumentów dotyczących wojny w obszarze miejskim (np. międzynarodowe regulacje).

Od strony technicznej, zostało to zrealizowane przy pomocy skryptu w języku programowania Python (https://github.com/minimaxir/aitextgen) oraz następujących tekstów źródłowych:

a) 5 Sumerian City Lamentation

Źródło: ETCSL - The Electronic Text Corpus of Sumerian Literature (an electronic archive of the University of Oxford’s Faculty of Oriental Studies).

b) historyczne traktaty na temat wojny (m.in. Carl von Clausewitz - On War)

c) dokumenty współczesne - raporty organizacji humanitarnych i regulacje międzynarodowe dotyczące wojny w obszarach miejskich.

Rezultaty - w pewnym sensie ograniczone poprzez mały zestaw danych - zostały uwzględnione w kolejnych etapach.

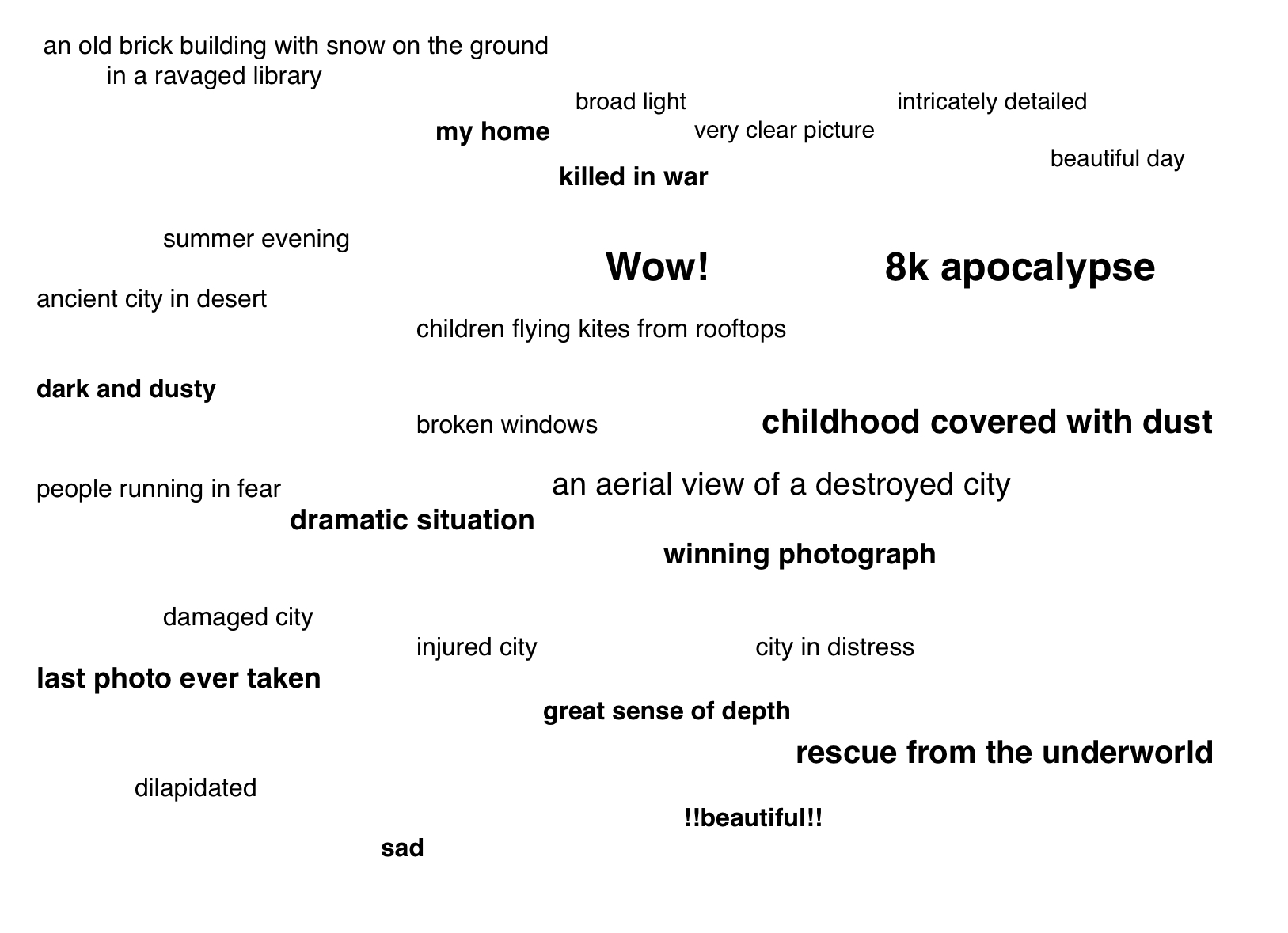

2) Zamiana obrazu na tekst za pomocą algorytmów uczenia maszynowego

- materiałem źródłowym stały się zdjęcia dostępne w internecie, przedstawiające obszary miejskie objęte wojną w okresie obejmującym życie kompozytorki. Była to decyzja Ewy Trębacz, aby do dokumentacji włączyć konflikty wojenne, które w pewnym sensie toczyły się "obok", w ostatnich latach XX i początkach XXI wieku. Konflikty te, mimo że pozornie obecne (poprzez dokumentację, wiadomości, prasę), nie do końca były zinternalizowane czy uświadomione poza obszarami wojny. Przedstawienie ich teraz w formie zagregowanej stało się brutalnym przywołaniem ich do świadomości w postaci zbioru danych wizualnych.

Ten zbiór danych został następnie poddany interpretacji poprzez skrypty zamieniające obraz na tekst - generując szereg opisów, nieraz absurdalnych, czasem bardzo dosłownych, pozornie "neutralnych" i nieprzystających do opisywanych wydarzeń. Takie surowe opisy, pozbawione jakichkolwiek emocji, zostały wykorzystane do współtworzenia krótkich „semi-poetyckich” form, z uwzględnieniem tekstów wygenerowanych w poprzednim etapie.

Przykłady wygenerowanych tekstów:

3) Wizualizacje: warianty obrazu i transkodowanie między mediami

W kolejnym kroku powyższy zbiór danych wizualnych został użyty do generowania wariantów obrazu, które odchodząc od realistycznych oryginałów, zamieniały się w formy zniekształcone lub abstrakcje. Następnie przy pomocy tzw. frame interpolation kompozytorka wygenerowała formy przejściowe między nimi, tworząc krótkie animacje.

Do animacji tych zostały też dodane trójwymiarowe modele utworzone na podstawie wybranych fotografii przedstawiających zniszczenia wojenne, następnie włączone do zbioru wizualizacji. Proces ten będzie kontynuowany w kolejnych iteracjach. Ewa Trębacz planuje dalsze zespolenie pomiędzy mediami, m.in. przez kontrolę pewnych aspektów wizualizacji poprzez dźwięk.

LAMENTACJA - ASAMBLAŻ 2

ETAP 4: PRZYSZŁE ITERACJE I WYKONANIE NA ŻYWO:

Projekt w tym etapie prezentuje podejście multiplatformowe, iteracyjne, które może być prezentowane w różnych formach, np:

- "Fixed-media" - krótkie formy wideo w postaci ustalonej, z dźwiękiem binauralnym lub ambisonii 3 rzędu, potencjalnie z wielokanałowym wideo prezentującym równoległe warianty

- Prezentacja z udziałem wykonawców na żywo, performans eksporujący interaktywne połączenia między warstwami mediów (np. w formie koncertu)

- Prezentacja w postaci immersyjnej, tzw. rzeczywistości rozszerzonej (XR - Extended Reality)

Projekt jest dokumentowany na żywo w j. angielskim na stronie internetowej: https://ewatrebacz.com/lament

Kolejna iteracja projektu i wykonanie publiczne, tym razem z udziałem muzyków, jest planowana na wrzesień 2025, podczas festiwalu Warszawska Jesień.

girlbot@ewatrebacz.com

girlbot@ewatrebacz.com BabelScores

BabelScores Youtube

Youtube SoundCloud

SoundCloud